408期・Cover Story 總論篇

技術快速發展 應用全面擴散

AI重塑世界面貌 啟動全球成長新引擎

◎撰文/陳玉鳳 圖片來源/中央社、Shutterstock、國科會

在人工智慧(AI)快速發展的當下,全球正進入一個既充滿創新機會,又伴隨各種爭議的全新時代。從科技巨擘的技術突破,到各國政府對「主權AI」(Sovereign AI)的積極布局,再到AI倫理與安全的挑戰,這些議題匯聚成令人期待又擔憂的AI時代前景。

在2025年,生成式人工智慧技術持續快速發展,大型語言模型(LLM)進入新一輪激烈競爭,成為全球科技產業主戰場。各家企業不僅在模型效能上追求突破,也在生態系統建立與應用情境方面展開全面角力。

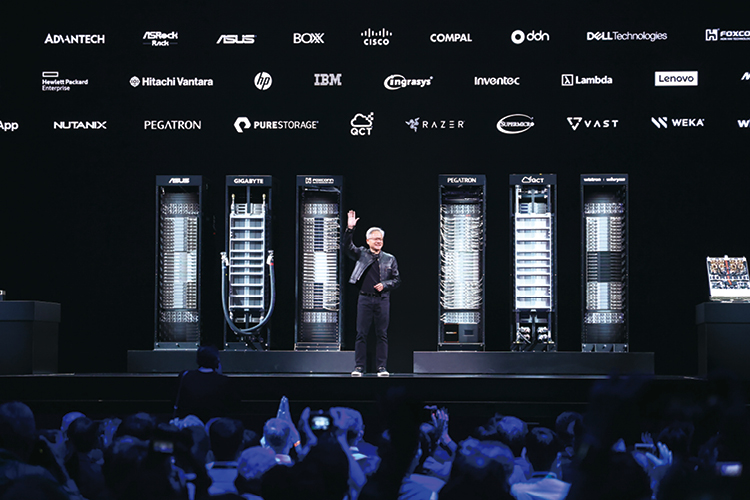

輝達(NVIDIA)執行長黃仁勳於2025年COMPUTEX的主題演講中,進一步為AI發展指出未來方向。他認為生成式AI的發展正邁向一個嶄新的階段,從「生成」走向「推理」,再從「推理」進一步延伸到「行動」。這樣的演化路徑,使AI不再只是文字輸出或影像生成的工具,而是具備感知、理解並能執行複雜任務的代理系統。黃仁勳強調,代理AI(Agentic AI)正是這一新階段的關鍵。

所謂「代理AI」,是指能夠接收任務目標,自主拆解任務、推理出最佳行動方案,進一步執行、調整與協作的人工智慧系統。它結合多模態輸入處理能力、工具操作能力,以及與其他AI代理互動的能力。黃仁勳強調對於未來的實體AI,也就是機器人來說,多模態理解是不可或缺的基礎。

正因如此,全球各大科技企業也紛紛朝向強化「推理能力」與「多模態理解」的方向精進AI模型,逐步實現可應用於實體世界的智能代理系統。其中,由前OpenAI高層Dario Amodei和Daniela Amodei兄妹共同創辦的Anthropic,於2025年推出更新版本Claude 3系列,進一步優化長文本理解與上下文記憶能力,支援超過100萬詞元(token)的連續輸入處理,廣泛應用於法律、醫療與企業知識管理系統。token是指將文字資料切分後的最小處理單位,它可能會是一個單字、部分單字、標點符號,甚至是一個中文字,模型在每次生成回應時有一個token數量上限。

Google持續擴展Gemini模型家族,2025年中旬推出Gemini 1.5 Ultra,強化程式推理能力與多模態資料整合,並內建強化版程式碼解譯器(Code Interpreter),可處理跨語言、多邏輯層次的複雜任務。Google並推動Gemini進入教育、醫療與政府系統,標誌其從研發模型邁向產業標準建構的轉變。

Meta在2025年持續拓展LLaMA 3模型的開源應用,並釋出多語言版本,強化非英語語系的模型表現。LLaMA 3在全球開發者社群持續受到歡迎,促進大量本地化模型與應用的誕生,成為開源陣營技術核心。

OpenAI則於4月底正式推出GPT-4o模型,全面取代先前的GPT-4。GPT-4o在推理效率、多模態交互及成本優化實現跨世代等級的進展,響應速度提升10倍,應用程式介面(API)價格降低50%。該模型支援即時語音對話、圖像生成與多輪對話編輯,顯示AI應用已從文字處理邁向更豐富的多模態互動。

AI走出實驗室 深入產業第一線

事實上,生成式AI發展已不再停留在技術展示或實驗階段,而是快速落地至各行各業,實質改變產業運作模式與使用者體驗。從醫療、法律到金融等高度專業化領域,AI應用正逐步深入核心流程。

在醫療領域,Google開發的Med-PaLM 2模型表現尤為亮眼。該模型專為臨床醫療問答設計,據實驗結果,其在美國醫師執照考試模擬問答中的準確率,已接近人類醫師水準。

這項成果不僅顯示AI在醫療資訊理解與邏輯推理上的能力大幅提升,也預示未來在遠距醫療、臨床決策輔助與健康教育等方面的應用潛力。

在法律領域,生成式AI也開始介入高度專業的文件處理與案件評估工作。由美國新創公司開發的Harvey AI已被全球知名的會計師事務所PwC,以及國際律師事務所Allen & Overy導入,協助律師草擬合約條款、進行法律條文比較與簡化合規審查流程。這些應用可大幅降低事務性工作時間成本,讓律師能專注於策略性與判斷性任務,進一步提升法律服務效率與品質。

金融產業亦不落人後。摩根大通(JPMorgan Chase)近年積極開發內部使用的AI對話模型「IndexGPT」,導入投資建議生成、客戶資產分析與理財產品說明等功能。此舉顯示生成式AI已逐漸轉向金融決策的核心應用,不僅能簡化投資顧問溝通流程,更有助於提供客製化、即時且具解釋性的服務體驗。

這些實務操作的成功經驗,為AI大規模產業化奠定範例與基礎,也讓社會大眾得以更直觀地理解AI技術的實際效益。

DeepSeek突圍 晶片管制升高風險

談到AI進展,當然不能略過DeepSeek。中國大陸AI新創公司DeepSeek於2025年初推出多款AI模型,包括通用模型V3、推理模型R1和多模態模型Janus-Pro-7B。這些模型在效能和成本效益方面表現出色,特別是R1模型,其推理能力與OpenAI的o1模型不相上下,且推理過程完全透明,吸引全球關注。

DeepSeek快速崛起引發美國關注。美國眾議員Bill Foster計劃提出立法,意欲限制NVIDIA等公司製造的先進AI晶片非法流入中國大陸,因這些晶片可能被用於支持DeepSeek等中國大陸AI公司發展,對美國企業造成重大損失。

DeepSeek於2025年初推出多款AI模型,包括通用模型V3、推理模型R1和多模態模型Janus-Pro-7B。

在美國持續收緊對中國大陸AI晶片出口政策下,全球兩大晶片企業領袖,NVIDIA執行長黃仁勳與AMD執行長蘇姿丰皆於近日表達對此政策的不以為然。他們呼籲美國政府在維護國家安全與維持科技領先間,應尋求更審慎與平衡的政策取徑。

黃仁勳直言不諱指出,中國大陸市場在AI領域潛力龐大,預估未來幾年將達到500億美元規模。若NVIDIA因此失去中國大陸市場,將是「龐大損失」,堪比「失去整個波音公司」的機會。他強調,目前的出口限制雖出於國安考量,但實際上無法有效阻止中國大陸軍方取得先進運算能力,反而可能激發中國大陸加快本土AI技術標準的發展,進而削弱美國在全球的技術影響力。據悉,NVIDIA已因此承受約55億美元收入損失,並被迫調整AI晶片設計,以符合美國管制規定,持續維持對中國大陸市場的供應能力。

與此同時,蘇姿丰也向美國國會表達相似立場。她指出,儘管出口管制是出於國家安全考量,但這些限制對美國企業的營收、庫存與供應鏈穩定構成巨大壓力。AMD預估2025年將因出口限制損失約15億美元營收,並面臨約8億美元庫存與採購損失。蘇姿丰強調,中國大陸是全球最大且最具成長潛力的市場之一,對美國科技企業來說是不可忽視的機會所在。若美國企業因此退出中國大陸市場,不僅喪失競爭優勢,也可能讓中國大陸發展出自主的AI技術體系,進一步侵蝕美國在AI產業的主導地位。

兩位業界領袖皆認為,美國政府應重新檢視目前的出口政策,適度調整對AI晶片的出口限制,避免因過度干預而傷害美國企業國際競爭力。他們也建議政府加大對AI基礎建設的投資,提升教育與研發能力,從根本上強化美國在AI競爭中的核心實力。

NVIDIA及AMD為推動全球AI發展的重要力量。其中,NVIDIA在2025年GTC大會發表新一代AI晶片Blackwell Ultra GB300和Vera Rubin。Blackwell Ultra GB300預計於2025年下半年出貨,Vera Rubin則預計於2026年下半年推出。這些晶片的記憶體容量和運算效能皆顯著提升,能夠滿足日益成長的AI運算需求。此外,NVIDIA與通用汽車(General Motors)展開合作,將AI技術應用於自駕車、工廠和機器人等領域,進一步拓展AI實際應用。

隨著AI技術快速發展,全球各國在AI領域的投資和技術布局也在加速。美國銀行預計,2025年全球AI資本支出總額將達到4,140億美元,比2024年成長44%,並在2026年進一步成長至4,320億美元。

AMD執行長蘇姿丰呼籲美國政府在維護國家安全與維持科技領先間,應尋求更審慎與平衡的政策取徑。

部署主權AI 確保數位主權及產業自主

不僅企業積極投資AI,出於國安考量,多國政府積極投入「主權AI」(Sovereign AI)布局。主權AI指的是由國家主導開發、訓練、部署與監管的人工智慧系統,旨在確保AI技術符合本國法律、文化與價值觀,並保障數據安全與國家利益。

此一概念興起,反映出各國對於AI技術依賴外部供應商可能帶來的風險關注。例如,英語主導的AI模型可能無法充分反映非英語國家的文化與價值觀,進而影響其決策與應用效果。

美國在AI領域採取以市場驅動為主的策略,強調創新自由與競爭優先。然而,面對中國大陸在AI領域的快速發展,美國政府開始意識到加強對關鍵技術的投資與產業鏈安全的重要性,以維持其在全球AI競爭中的領先地位。歐盟則採取更嚴謹的監管方式,強調建立全面的法律框架來保護道德標準與基本權利。歐盟的AI政策注重風險管理與倫理考量,以確保AI技術發展符合歐洲價值觀與社會需求。

另據《金融時報》報導,沙烏地阿拉伯也於日前宣布成立「Humain」公司,由公共投資基金(PIF)出資,推動AI技術與基礎設施發展,包括建設大型數據中心和開發阿拉伯語大型語言模型(LLMs),以將該國定位為全球AI創新中心。

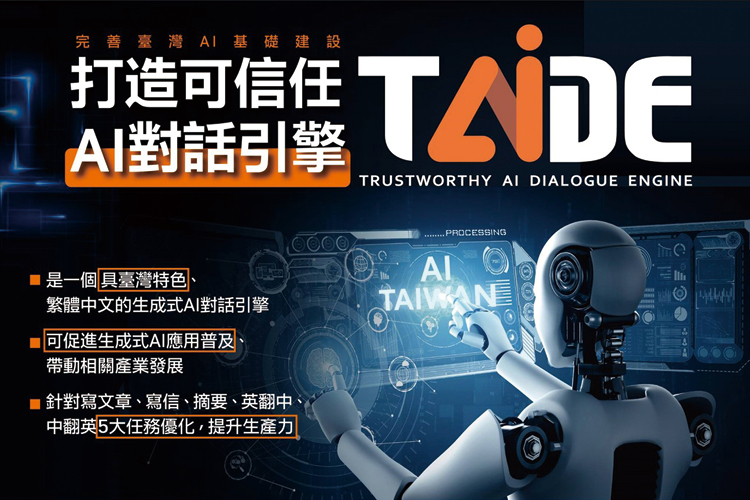

至於台灣,面對全球AI技術競爭與地緣政治壓力,勢必須發展主權AI,以確保數位主權與國家安全。我國政府推動「可信任生成式AI對話引擎」(TAIDE)計畫,利用在地繁體中文資料訓練模型,並建置自主算力資源,減少對外部供應商的依賴。

此外,台灣也著手建立AI產業生態系,以推動AI技術在各行各業的應用,並制定相關法規與標準,以確保AI技術的發展符合國家利益與社會需求。

台灣政府推動「可信任生成式AI對話引擎」(TAIDE)計畫,利用在地繁體中文資料訓練模型,並建置自主的算力資源,減少對外部供應商的依賴。

驅動生產力轉型 衝擊職場結構

AI應用建置如火如荼,然而亂象叢生令人愈來愈擔心,尤其深度偽造(Deepfake)技術已被廣泛應用於製作虛假影片和音訊,造成資訊操控與詐騙等問題。例如,詐騙集團利用AI技術製作虛假的名人影片,以及偽裝成知名企業徵才,透過建立信任與權威感,騙取民眾資產。甚至有報導指出,生成式AI工具給出的答案中,可能暗藏惡意程式碼,對用戶造成潛在風險。

此外,AI技術在自主系統中的應用也引發安全疑慮。例如Alphabet旗下專注於自動駕駛技術的子公司Waymo,其自動駕駛車輛曾於舊金山撞上一名自行車騎士,導致受傷。Cruise的自動駕駛車輛此前捲入一起行人事故,行人被撞後遭車輛拖行,需使用破壞工具救援。這些事件引發自動駕駛技術在實際道路環境中安全性的質疑。

AI系統的決策過程往往缺乏透明度,導致在出現錯誤或偏見時,難以追究責任。根據美國AI安全公司Enkrypt AI於2025年1月31日發布的紅隊測試(模擬實際攻擊者行為的安全測試)報告指出,中國大陸開發的DeepSeek-R1模型在多項安全測試中表現不佳,顯示嚴重的倫理與安全風險。

面對AI帶來的倫理與安全挑戰,各國政府採取不同的監管策略。美國在2025年初由總統川普簽署第14179號行政命令,撤銷前任政府的AI監管措施,轉向以解除管制為核心,推動AI創新。相較於美國放鬆監管,歐盟於2025年4月14日通過全面性的AI法案,針對不同風險等級的AI應用制定相應的監管措施,強調透明度與安全性。

全球在AI監管上的分歧加劇,使得建立統一的AI倫理與安全標準面臨挑戰。2025年2月在巴黎舉行的AI峰會上,各國領袖與科技巨頭共同探討AI發展的包容性與永續性議題,但由於監管方向的差異,協調工作面臨重大挑戰。如何建立「負責任的AI發展」機制,成為AI未來發展的重要關鍵。

無論如何,AI應用正逐步滲透至各行各業,提升生產效率、創造新商機。據麥肯錫研究,生成式AI有望每年為全球經濟增加2.6兆至4.4兆美元的GDP成長,涵蓋全球47個國家和地區及850種職業。此外,Gartner預測,到2026年,超過8成的企業將在營運環節中部署生成式AI,以提高生產力及提升服務效能。這些數據顯示,AI技術的發展將成為推動經濟成長的重要引擎。

在人工智慧技術加速發展的同時,其對勞動市場的衝擊也日益顯現,成為各國政府與產業高度關注的重要議題。據經濟合作暨發展組織(OECD)2024年的調查結果指出,在34個成員國中,高達27%的白領職位存在被AI部分取代的風險,特別是法律、財務、人資與行政等領域,皆因其流程高度標準化、可預測,被視為AI應用的首要目標。不過,這些工作並不會完全消失,而是逐漸轉型為需具備資料理解力、AI協作能力與複雜問題解決能力的新型角色。

整體來看,AI正快速重塑勞動結構,其帶來的挑戰與機會同樣龐大。當人機協作成為未來常態,如何藉由政策、制度與教育的前瞻部署,引導勞動市場轉型、協助工作者適應角色變化,以及建立AI輔助學習的信任基礎,將是各國政府與社會無法迴避的下一階段課題。■

發行人語

AI重塑世界IEAT拓展新鏈結

|封面故事|

Cover Story 總論篇

AI重塑世界面貌啟動全球成長新引擎

Cover Story 全球篇

從科技巨擘到新創企業搶進算力賽道

Cover Story 人形機器人篇

走進真實場域人形機器人開啟新紀元

|推薦閱讀|

特別企劃

現場直擊!2025台灣數位貿易博覽會

特別企劃

拓展中歐新夥伴助台灣產業搶進

歐洲新興市場

企業領航

惠旺工業的品牌創新之路

亞太視角

新加坡轉型再進化突圍高科技與多邊浪潮

國貿心法

進出口通關實務與進口稅費計算(三)

計算篇

產經情勢

全球經貿秩序變動企業迎戰複合型衝擊

永續連結

碳費徵收倒計時!全體總動員

「永續初考核」

IEAT 動態

同興實業與IEAT攜手跨越七十載

![30771_公會LOGO%20W%20[轉換] 01](img/30771_公會LOGO.png)