396期・寰宇聚焦

從歐盟「人工智慧法案」 探測AI安全風向

AI大監管 全面啟動

◎撰文╱陳怡寧 圖片提供/Shutterstock、AFP

當人工智慧時代來臨,全球面對未知不可測的領域,如何監管?由誰監管?成了迫切的問題。人類史上首次的「人工智慧安全峰會」(AI Safety Summit)2023年底才在英國倫敦上演,不久後,歐盟執委會接力展開為期3天的馬拉松協商,通過「人工智慧法案」(AI Act),成為全球首部AI立法,產業密切靜觀驟起的監管風向。

生成式AI遍地開花,這是無法迴避的全球浪潮,歐盟「人工智慧法案」成為全球首部監管AI的規範框架,依風險程度,約束不同領域的AI應用。

隨之而來的AI監管氛圍日益濃厚,甚至被視為美中貿易冷戰競爭的延伸,各國大多抱持觀望態度,歐盟、美國、中國大陸各有一套監管倡議,形成「三足鼎立」之勢,顯見全球AI治理不再只是單一標準。

產業AI需求擴張 監管治理將是重要課題

跳脫全球AI競賽思維,國際間之所以嚴陣以待AI監管,是因AI、物聯網應用已深入產業,全球市場調研權威「勤業眾信」蒐集企業意向,反映半數以上的工業製造、科技、醫療、零售業產生對AI需求,涵蓋財務會計管理(83.7%)、法遵監督(66.5%)、技術研發管理(60.4%),務實來說,是機器學習、機器人流程自動化、生物辨識和聊天機器人服務。

AI功能導入供應鏈優化、產品設計,已成趨勢。IDC更以「無處不在的AI」為題,觸角將延伸至銷售營運、研發設計、製造、客服,甚至供應鏈和財務等部門,在種種演算協作下建立資料庫,可能觸碰到企業內、外部的個人資料保護、著作權、智慧財產權、營業秘密等敏感運作。

AI影響層面難以量化,監管對應到治理、道德因素,超乎傳統產業監管的既有想像,因此資策會科技法律研究所不得不謹慎應對。

AI監管架構 風險管理的關鍵心法

在不扼殺創新、適度監管AI的平衡過程中,KPMG勾勒出AI監管的輪廓,關於AI演算法與大數據風險監管架構,大致符合下述心法:

心法1》平衡技術與風險

發展所有AI應用技術的前提是,以合理的法規遵循切入評估,預先掌握建構相對應的風險管理框架。

心法2》了解演算法的限制

AI高速演算網羅海量數據資料,必要時應提示原始資料限制因素。

心法3》必要的人為介入

AI監管不易以一概全,終究回歸治理的本質,也就是「責任」。當企業導入AI應用,不要完全仰賴AI決策,須設計人工介入的條件與時機,必要時啟動應變機制,將決策交還於「人」,讓AI的掌控權還是「操之在人」。

國際監管浪潮 全球巨頭的AI安全承諾

現階段生成式AI應用軌跡的確是產業先行,還處於早期階段,供應商尚未完全解決隱私、安全、準確性、版權和濫用等問題,國際間合作監管還在努力跟上腳步,經濟合作暨發展組織(OECD)、人工智慧全球合作組織(GPAI)陸續倡導AI發展倫理原則。

目前,各國政府以現有監管手段套用於AI領域,但IDC透露,AI監管內涵更在於數據隱私安全、著作權、濫用等問題。在這樣的提醒下,全球更加重視AI監管,就以歐盟通過「人工智慧法案」鳴槍。

歐盟》人工智慧規範法案(AI Act)

歐盟在2023年以499票贊成、28票反對、93票棄權的票數,壓倒性通過人工智慧法案。身為全球第一個AI監管法令框架,極具指標意義,且可能影響後續AI監管架構。

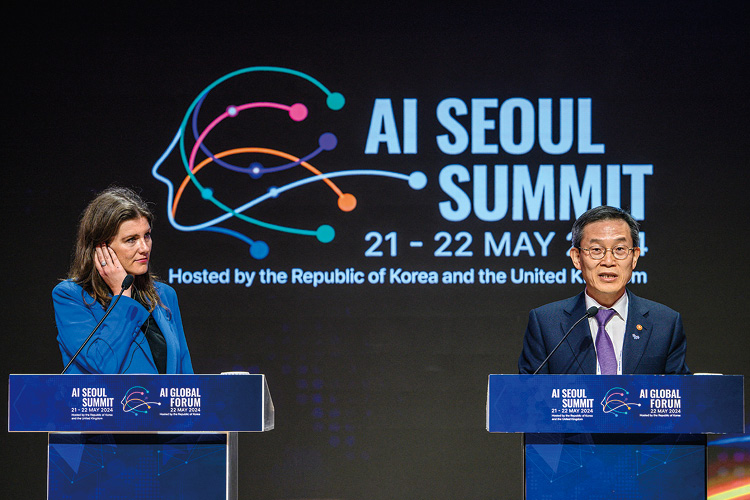

AI、物聯網應用已深入產業,2023年底英國倫敦進行「人工智慧安全峰會」後,2024年也持續參與全球各國間的AI技術交流發布會。

在歐盟人工智慧規範法案(AI Act)裡,適用範圍從ChatGPT到金融詐欺,將AI監管區分成最小風險、高風險、不可接受風險和特定透明度風險等四大類。

不可接受之風險

包括在公共場所使用人臉、指紋、虹膜辨識系統等無差別生物特徵識別。

在公共場所使用人臉、指紋、虹膜辨識系統等無差別生物特徵識別屬不可接受之風險類。

高風險

可能影響司法系統、職業資歷篩選、績效評估,社會醫療保險、信用額度,或移民庇護、邊境管理相關簽證文件真實性的應用。

有限風險

具特定透明度的AI系統(已知的演算法、資料處理流程),如聊天機器人、Chat GPT等,須告知使用者得到的回應是由機器人生成。

最小/無風險

電玩、垃圾郵件過濾應用的AI系統。目前歐盟市面上多數的AI系統屬這層級。

美國》人工智慧行政命令

幾乎在同樣時間點,美國總統拜登簽署一份「人工智慧行政命令」(AI Executive Order),確立未來AI發展的八大項行動目標,基本上定調AI應用原則。

☞ 建立AI安全的新標準。

☞ 保護美國人的隱私。

☞ 促進公平與公民權利。

☞ 替消費者、病患及學生挺身而出。

☞ 支持勞工。

☞ 推動創新與競爭。

☞ 提升美國在海外的領導地位。

☞ 確保政府負責任及有效地使用AI。

這是繼美國白宮2020年初發表「AI應用監管指南」(Guidance for Regulation of Artificial Intelligence Applications),公開表態美國監管立場後,再一次傳達監管AI的決心。美國總統簽署並頒布的「行政命令」,作為未來政策藍圖的依據,極具高度前瞻價值。

雖具體監管法規還在討論階段,但美國白宮在2023年7月陸續與谷歌、微軟、OpenAI等企業取得AI安全承諾,此次AI人工智慧行政命令更廣泛涉入社會領域,在在暗示著美國監管AI的企圖,尤其命令第一點是重中之重,「建立AI安全的新標準」短短幾字,意味全面地防範AI潛在風險的危害。

美國總統拜登簽署「人工智慧行政命令」,確立未來AI發展的八大項行動目標。

G7》人工智慧行為準則

七大工業國集團(G7)在將近半年的協商後,終於通過國際通用的「AI行為準則」,目的在確保AI應用得當,全球業者可以自願參與。監管治理面向包括:

☞ AI產品需提前進行外部測試。

☞ 公開的安全與資安評估報告。

☞ 揭露隱私與風險政策。

☞ 保護智慧財產權。

☞ 以浮水印或其他方法標註為AI生成內容。

☞ 投資AI安全相關研究。

☞ 優先開發出能夠應對氣候危機等全球挑戰的AI系統。

☞ 確立測試與內容驗證的國際標準。

中國大陸》全球人工智慧倡議

在歐美監管態勢逼迫下,中國大陸國家主席習近平在第三屆「一帶一路」國際合作高峰論壇上,正式提出「全球人工智能治理倡議」,在全球AI角力爭奪話語權。

☞ 智能向善,引導AI朝著有利於人類文明進步的方向發展。

☞ 反對透過意識形態畫線或構建排他性集團,惡意阻撓他國的人工智能發展。

☞ 主張建立AI風險等級測試評估體系,提升AI技術的安全性、可靠性、可控性、公平性。

☞ 支持在聯合國框架之下討論成立國際級AI治理機構。

☞ 加強面向開發中國家所需的國際合作與援助,以彌合智能鴻溝和治理差距。

跨世紀的監管思維 台灣產業也跟上

全球AI監管浪潮也在台灣產業掀起滔天巨浪,尤其金融環境嚴謹要求資安,2023年底金管會首先發布「金融業AI運用指引草案」,揭露金融業運用AI核心原則在於落實系統穩健性、安全性、透明性,並保護客戶隱私權益,是國內的第一份產業AI指引,未來亦有可能作為其他產業實務的監管法遵參考。

國際間對AI監管架構還沒有定論,宣示性質的倡議居多,僅有歐盟人工智慧規範法案框架相對完整,資策會科技法律研究所觀察,現在生成式AI引發的海嘯,相當於上個世紀的網際網路所帶來的衝擊,可以嘗試從網路規管的架構模式思考,作為AI監管手段的建置基礎。■

發行人語

用AI打一場貿易資訊戰|封面故事|

Cover Story 總論篇

貿易AI新時代!台灣外貿產業新商機

Cover Story 趨勢篇

進軍智慧外貿!用AI打一場貿易資訊戰

Cover Story 實戰篇

外貿智慧大未來!用AI接軌全球商機

|推薦閱讀|

特別企劃

「種草」幕後的電商戰場!

直擊華人圈爆款帶貨力

寰宇聚焦

AI大監管 全面啟動產業趨勢

全球反勞動逆襲!進出口貿易避雷針

永續脈動

減碳再加把勁逆轉氣候暖化指日可待

國貿實務

國際貨物運輸保險與貨損理賠實務(二)

開創心路

鮮乳坊朝向產業永續迎戰紐西蘭零關稅牛乳

領導之力

顛覆傳統同理心行銷策略3步驟

![30771_公會LOGO%20W%20[轉換] 01](img/30771_公會LOGO.png)